오프닝: 개발자의 집중력, '컨텍스 스위칭'의 적을 찾아라

코드마스터입니다. 핵심부터 엑스레이를 찍어보겠습니다. 현대 소프트웨어 엔지니어링, 특히 클라우드 네이티브(Cloud-native) 환경을 다루는 DevOps나 SRE(Site Reliability Engineering) 엔지니어들에게 터미널은 단순한 명령 입력창이 아닙니다. 그것은 시스템의 심장부와 소통하는 유일한 인터페이스이자, 모든 워크플로우가 흐르는 혈관입니다.

하지만 우리는 종무한 과제에 직면합니다. 서버의 로그를 분석하거나, 파이프라인을 통해 추출된 CSV 데이터를 확인해야 할 때, 우리는 무의식적으로 엑셀(Excel)이나 구글 시트(Google Sheets)를 실행합니다. 이 순간, 완벽했던 우리의 집중력은 산산조각이 납니다. 터미널이라는 텍스트 기반 환경에서 화려한 GUI(Graphical User Interface) 애플리케이션으로 넘어가는 과정에서 발생하는 '컨텍스트 스위칭(Context Switching, 문맥 전환)'은 개발자의 인지 부하를 급격히 높이고 생산성을 저하시키는 주범입니다.

한국의 IT 기업들이 클라우드 전환과 마이크로서비스 아키텍처(Microservices Architecture)를 채택하면서, 우리는 그 어느 때보다 방대한 양의 비정형 데이터를 터미널 환경에서 다루게 되었습니다. 이제, 터미릿 환경을 벗어나지 않고도 스프레드시트를 완벽하게 제어할 수 있는 방법이 왜 중요한지, 기술적인 관점에서 짚어보겠습니다.

핵심 내용: 기존 방식의 한계와 새로운 패러다임

많은 개발자가 터미널 내에서 데이터를 확인하기 위해 나름의 노력을 기울여 왔습니다. 가장 기초적인 `cat` 명령어부터 시작해, 데이터의 구조를 조금 더 예쁘게 보여주는 `csvlook`이나 파이썬의 `Pandas` 라이브러리를 활용한 스크립트 실행까지, 다양한 시도가 있었습니다. 하지만 이러한 방식들은 명확한 한계를 가집니다.

첫째, `cat`이나 `less`와 같은 단순 출력 명령어는 데이터의 구조(Structure)를 무시합니다. 열(Column)의 경계가 모호해지며, 데이터가 조금만 커져도 가독성이 급격히 떨어집니다. 둘째, `csvlook`과 같은 도구는 데이터의 스케일링(Scaling, 규모 확장) 문제에 취약합니다. 수만 행에 달하는 대용량 CSV 파일을 로드할 때, 터미널의 버퍼 한계나 렌더링 성능 문제로 인해 시스템이 느려지는 현상이 발생하곤 합니다. 셋째, 데이터의 수정이나 필터링을 위해서는 결국 별도의 스크립트를 작성하거나 외부 에디터를 호출해야 하는 번거로움이 있습니다.

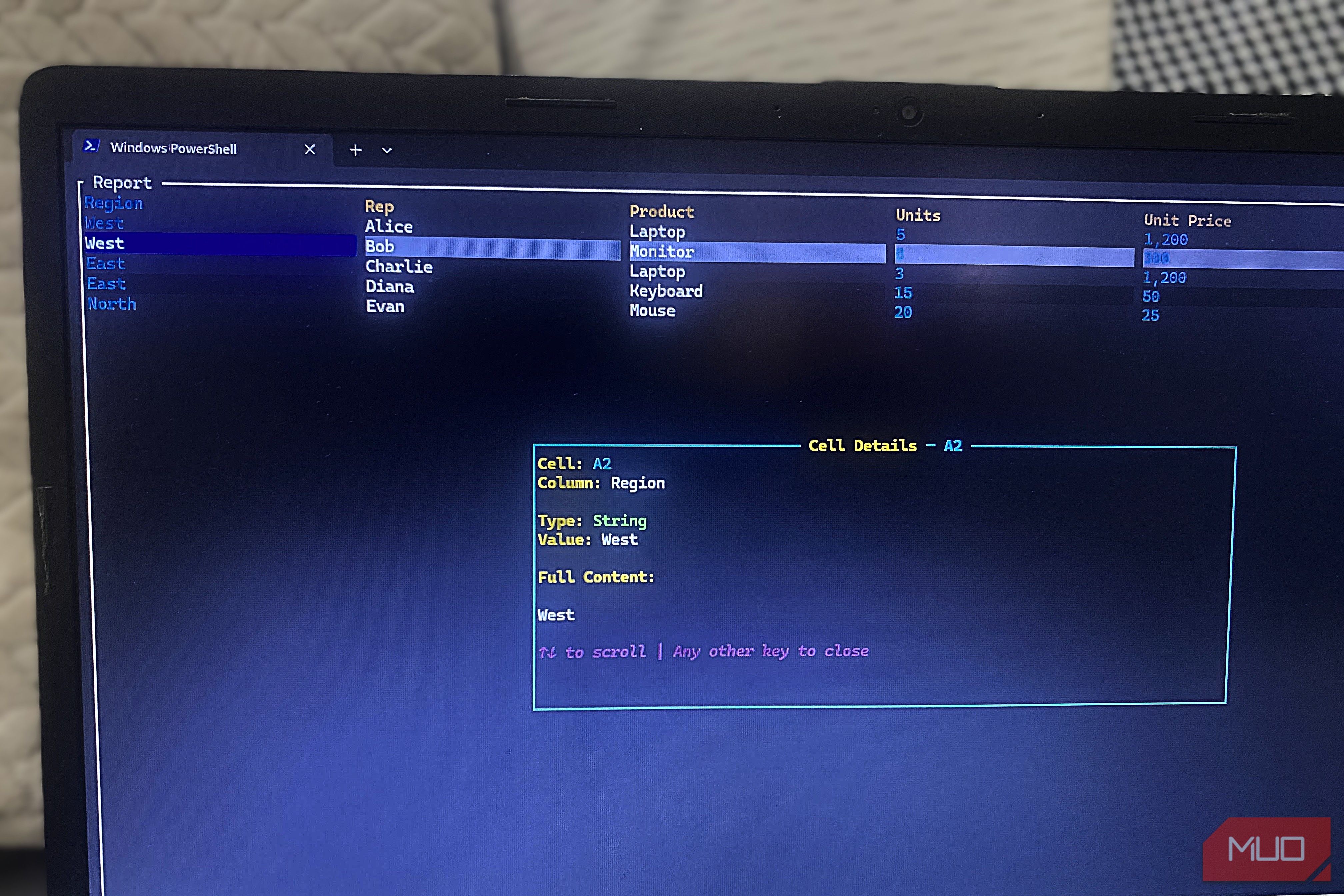

이러한 문제의 핵심은 '데이터 뷰어'와 '데이터 프로세스'가 분리되지 않았다는 점에 있습니다. 우리가 원하는 것은 단순한 텍릿(Text) 출력이 아니라, 터미널의 텍스트 기반 환경을 유지하면서도 스프레드시트의 강력한 기능(필터링, 정렬, 계산)을 사용할 수 있는 '디커플링(Decoupling, 분리)'된 인터페이스입니다. 마치 컨테이너(Container) 환경에서 애플리케이션과 인프라를 분리하여 관리하듯, 데이터의 원본은 유지하되 뷰어(Viewer)만 가볍게 교체할 수 있는 도구가 필요한 시점입니다.

심층 분석: 왜 CLI 기반의 데이터 핸들링인가?

여기서 우리는 기술적인 질문을 던져야 합니다. 왜 굳이 불편해 보이는 터미널 환경을 고집해야 하는가? 그 답은 '자동화'와 '파이프라인(Pipeline)'에 있습니다. 훌륭한 개발자의 워크플로우는 모든 것이 연결되어 있습니다. `curl`로 데이터를 가져오고, `grep`으로 특정 패턴을 추출하며, `awk`로 데이터를 가공한 뒤, 최종적으로 그 결과를 확인하는 과정이 하나의 유기적인 흐록으로 이어져야 합니다.

기존의 GUI 기반 스프레드시트 방식은 이 파이프라인을 끊어버립니다. 데이터를 파일로 저장하고, 엑셀을 실행하고, 파일을 여는 과정은 자동화가 불가능한 '레거시(Legacy)'적인 수동 작업입니다. 반면, 강력한 CLI 기반 스프레드시트 도구(예: VisiData 등)는 표준 입력(stdin)을 통해 들어오는 데이터를 즉시 처리할 수 있습니다. 이는 CI/CD(지속적 통합/지속적 배포) 파이프라인 내에서 데이터 검증 단계를 구축할 때 엄청난 이점을 제공합니다.

또한, 경쟁 도구인 GUI 기반 엑셀과 비교했을 때, CLI 도구는 자원 효율성 측면에서 압도적입니다. 엑셀은 대용량 파일을 열 때 막대한 메모리를 점유하며 시스템 전체의 SLA(Service Level Agreement, 서비스 수준 협약)를 위협할 정도로 리소스를 잡아먹기도 합니다. 하지만 잘 설계된 오픈소스(Open-source) 기반의 CLI 도구들은 텍릿 기반의 가벼운 렌더링 엔진을 사용하여, 저사양 서버나 원격 SSH 접속 환경에서도 끊김 없는 데이터 탐색을 가능하게 합니다.

여러분은 어떻게 생각하십니까? 업무 중 엑셀을 켜기 위해 탭을 전환하는 순간, 다시 업무로 돌아오기 위해 얼마나 많은 에너지를 소모하고 계신가요? 혹시 여러분만의 터미널 생산성 도구가 있다면 무엇인가요?

실용 가이드: 터미널 생산성을 높이는 체크리스트

터미널 환경에서의 데이터 핸들링 능력을 한 단계 업그레이드하고 싶은 분들을 위해 몇 가지 실무 팁을 제안합니다.

1. 도구의 선정 (Tool Selection): 단순 확인용이라면 `csvkit` 시리즈를, 본격적인 데이터 분석 및 편집이 필요하다면 `VisiData`와 같은 강력한 인터랙티브 도구를 설치하십시오. `pip install visidata` 한 줄이면 충분합니다. 2. 파이프라인 구축: `cat data.csv | visidata -`와 같이 표준 입력을 활용하는 습습을 들이십시오. 파일 저장 없이 즉시 데이터를 검토하는 습관이 컨텍스트 스위칭을 줄여줍니다. 3. 환경 구성 (Environment Setup): `tmux`나 `screen`과 같은 터미널 멀티플렉서를 활용하여, 한쪽 화면에는 로그 스트림을, 다른 쪽 화면에는 데이터 뷰어를 띄워두는 레이아웃을 구성하십시오. 4. 대용량 파일 대응: 수 GB 단위의 로그 파일을 다룰 때는 메모리 스케일링 문제를 고려해야 합니다. 전체를 로드하는 방식보다는 `split` 명령어로 파일을 분할한 뒤, 필요한 부분만 뷰어로 확인하는 전략을 사용하십시오.

필자의 한마디

도구는 결국 수단입니다. 하지만 그 수단이 우리의 사고 흐름(Flow)을 방해한다면, 그것은 더 이상 도구가 아니라 장애물입니다. 터미널 환경에서의 데이터 뷰어를 찾는 여정은 단순히 편리함을 찾는 과정이 아니라, 개발자로서의 몰입(Flow)을 지키기 위한 투쟁입니다.

앞으로 클라우드 환경이 더욱 복잡해질수록, 우리는 더 정교하고 가벼운 도구들을 요구하게 될 것입니다. 오늘 소개한 개념이 여러분의 워크플로우를 혁신하는 작은 씨앗이 되기를 바랍니다.

실무 관점에서 결론은 명확합니다. 엑셀을 끄고 터미널에 집중하십시오. 여러분의 생산성은 그 차이에서 결정됩니다.

여러분의 터미널 환경은 안녕하십니까? 댓글로 여러분만의 '최애' CLI 도구를 공유해 주세요. 코드마스터였습니다.

출처: "https://www.makeuseof.com/terminal-tool-favorite-way-to-view-spreadsheets-on-computer/"

댓글 0

가장 먼저 댓글을 남겨보세요!

전문적인 지식 교류에 참여하시려면 HOWTODOIT 회원이 되어주세요.

로그인 후 참여하기