AI 모델의 패러다임 전환: 구조적 재설계를 통한 경량화

최근 인공지능(AI) 산업의 가장 큰 화두는 '거대 모델(LLM)의 효율적 운영'입니다. 모델의 크기가 커질수록 요구되는 컴퓨팅 자원과 비용이 기하급수적으로 증가하기 때문입니다. 이러한 상황에서 Multiverse Computing이 발표한 새로운 기술은 단순한 모델 압축을 넘어, 모델의 '설계도(Blueprint)' 자체를 재구성하여 메모리 사용량을 50%까지 줄일 수 있는 돌파구를 제시했습니다.

1. 기존 방식의 한계와 새로운 접근법

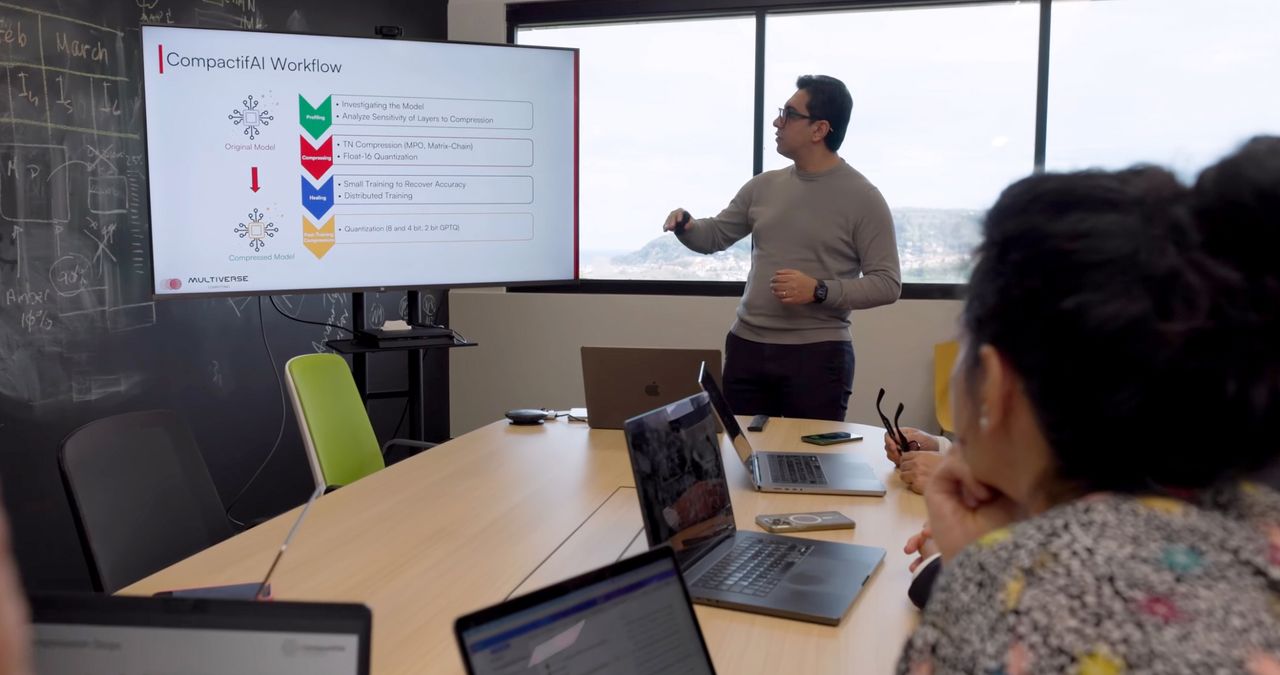

지금까지의 모델 경량화 기술은 주로 가지치기(Pruning)나 양자화(Quantization)에 의존해 왔습니다. 가지치기는 중요도가 낮은 파라미터를 제거하는 방식이며, 양자화는 데이터의 정밀도를 낮추어 용량을 줄이는 방식입니다. 하지만 이러한 방식은 반복될수록 모델의 지능(Accuracy) 저하를 초래하는 트레이드오프(Trade-off) 문제가 발생합니다.

반면, Multiverse Computing의 접근 방식은 다릅니다. 이들은 모델의 파라미터를 단순히 깎아내는 것이 아니라, 모델이 정보를 처리하는 구조적 논리 자체를 최적화합니다. 이는 마치 건물의 자재를 빼서 건물을 약하게 만드는 것이 아니라, 동일한 강도를 유지하면서도 훨씬 적은 자재로 견고한 구조를 설계하는 것과 같습니다.

2. 기술적 핵심: 파라미터 효율성과 메모리 절감

이 기술의 핵심은 파라미터 효율성에 있습니다. 모델의 핵심적인 연산 로직은 유지하면서, 불필요한 중복 연산을 제거하고 데이터 흐름을 최적화함으로써 다음과 같은 효과를 기대할 수 있습니다.

* 메모리 점유율 50% 감소: 모델이 차지하는 VRAM(비디오 램) 용량을 절반으로 줄여, 더 적은 수의 GPU로도 대규모 모델 운영이 가능합니다. * 추론 속도 향상: 데이터 처리 경로가 단축됨에 따라 토큰 생성 속도(Token per second)가 향상됩니다. * 에너지 효율성 증대: 연산량 감소는 곧 전력 소모 감소로 이어져, 지속 가능한 AI 운영을 가능하게 합니다.

3. 산업계에 미칠 영향: 엣지 AI와 클라우드 비용 절감

이 기술이 상용화될 경우, 두 가지 측면에서 거대한 변화가 예상됩니다.

첫째, 엣지 AI(Edge AI)의 확산입니다. 스마트폰, 드론, 자율주행차와 같이 컴퓨팅 자원이 제한된 환경에서도 고성능 LLM을 구동할 수 있는 기반이 마련됩니다. 이는 클라우드 연결 없이도 기기 자체에서 지능형 서비스를 제공하는 '온디바이스 AI' 시대를 가속화할 것입니다.

둘째, 클라우드 운영 비용(OPEX)의 혁신적 절감입니다. 기업들은 동일한 하드웨어 인프라에서 두 배 더 많은 모델을 서빙할 수 있게 되며, 이는 AI 서비스의 경제성을 확보하는 데 결정적인 역할을 할 것입니다.

결론: AI 대중화의 열쇠, '효율성'

AI 모델의 크기를 키우는 '스케일링 법칙(Scaling Law)'이 한계에 부딪힐 수 있다는 우려가 나오는 가운데, Multiverse Computing의 이번 발표는 '더 작고, 더 빠르고, 더 저렴한' AI를 향한 중요한 이정표를 제시했습니다. 모델의 크기가 아닌, 구조의 효율성이 미래 AI 경쟁력의 핵심이 될 것입니다.

댓글 0

가장 먼저 댓글을 남겨보세요!

전문적인 지식 교류에 참여하시려면 HOWTODOIT 회원이 되어주세요.

로그인 후 참여하기